Flutterとかの長いログ

- 2026/04/21

- aikawa

TL;DR

長大なログを何とかコンパクトに読みたいよね。え、全体を隈なく読むのが楽しい?そう・・・。

本題

Flutterのログって起動中ずっと流れっぱなしになってて、分割も出来ないしクリアするしかないんですよね。お前にはページの概念はないのか、とか思いませんか。

(お前と言うか、Flutter以外も含んだ複数形ですが)

そんな所を何とかしたいなと、コンセプトとして作りました。

https://github.com/lancard-aikawa/FlutterBoard

ローカルWebサーバを管理するローカルWebサーバが欲しい

- 2026/04/14

- aikawa

そして管理するWebサーバを管理するWebサーバを・・・。

前回は、Claude History Viewerを作りましたが、他にもローカルで動くプログラムを結構作ったりします。

ただ、毎回探して起動するのが面倒なんですよね。

ちょっと起動してないと、場所や名前を忘れたりするし。

そんなわけで、Windows起動時に立ち上がって管理出来るランチャーを作りました。

Claudeが。

https://github.com/lancard-aikawa/LocalLauncher

Windows専用設計なので、それ以外で動かすには調整が必要だと思います(特にランチャーの自動起動)。

Claude Codeのスキルを自作してPRレビュー確認を楽にした話

- 2026/04/08

- haraguchi

発端

開発メンバーがClaude CodeでPRのCodeRabbitレビューを確認しようとした時の話です。コメント数が多いPRだと、ghコマンドで取得したJSONが大きすぎてツール出力がファイルに退避され、そのファイルを読もうとするとまた大きすぎてさらに別ファイルに退避され……と連鎖して、動作が不安定になるという問題が起きていました。

結局Claudeから「ブラウザでGitHubのPRページを開き、具体的な指摘内容をコピペしてもらうのが一番確実です」と返されたそうです。

そこでClaude Codeのスキルで何とかできないかと思い、作ってみました。

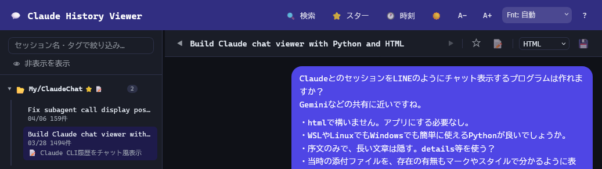

Claude CLIの会話履歴をチャット風に表示するプログラム

- 2026/04/06

- aikawa

リポジトリはこちらになります。

https://github.com/lancard-aikawa/ClaudeHistoryViewer

画面はこんな感じで、左にフォルダ・セッションの一覧が表示され、セッションをクリックすると右にチャット風に表示されます。

ClaudeのInteractive Visualsを使ってみた

- 2026/03/16

- aikawa

データベースコンテナでのバックアップの話(Docker)

- 2025/08/05

- murave

- Docker

- PostgreSQL

先週、NISA(一般社団法人長崎県情報産業協会)の『Pythonと Docker ではじめる Web アプリ開発&運用入門』という研修に参加しました。

その中でコンテナ上のデータベースの論理バックアップの話があり、ホストPCにdumpツールを入れて普通にバックアップすればOKという流れだったのですが、自分はこの考え方で面倒な状況に陥ったことがありましたので

「稼働中のデータベースコンテナと同じイメージ上のdumpツールを別コンテナ起動してバックアップした方がバージョンミスマッチを回避できるので良いと思います」

というフィードバックをしました。

講師の方には伝わっていたと思いますが、痛い目の話、実際の例、あとちょっとしたハマりどころについて書いておこうと思います。

この投稿の続きを読む »![]()

![]()

![]()

![]()

![]()

VirtualBoxのUbuntuにFlutter開発環境を構築

- 2025/04/10

- aikawa

- Flutter

- VirtualBox

CygwinとかWSLを使っても、駄目な時は本当に駄目というか、それ専用で動かす労力が必要と考えると(修正しても後で動かなくなる可能性が・・・)。

そんなわけで、shellがそのまま動かせるLinux+Flutter開発環境が欲しくなったので、ちょっとUbuntu上に作ってみます。

MCPサーバ開発を試してみた

MCPサーバをPython SDKを使って、作ってみました。

プロジェクトの作成

まずテンプレートからプロジェクト作成します。

uvx create-mcp-server

プロジェクト名等を聞かれるので、適当に入力します。プロジェクト作成後、指示に従って以下のコマンドを実行します。

cd <プロジェクト名>

uv sync --dev --all-extras

Gemini Canvasを使ってみる

- 2025/03/28

- aikawa

最終成果物はこちら。https://g.co/gemini/share/7ab5bd6ba55f